Inleiding tot classificatie-algoritmen

Dit artikel over classificatie-algoritmen geeft een overzicht van verschillende classificatiemethoden die vaak worden gebruikt in dataminingtechnieken met verschillende principes. Classificatie is een techniek die gegevens in een bepaald aantal klassen categoriseert en op zijn beurt label aan elke klasse wordt toegewezen. Het belangrijkste doel van classificatie is om de klasse te identificeren om nieuwe gegevens te lanceren door analyse van de trainingsset door de juiste grenzen te zien. In het algemeen wordt het voorspellen van de doelklasse en het bovenstaande proces classificatie genoemd.

Het ziekenhuismanagement registreert bijvoorbeeld de naam, het adres, de leeftijd, de geschiedenis van de gezondheid van de patiënt om deze te diagnosticeren, dit helpt om de patiënten te classificeren. Ze kunnen worden gekarakteriseerd in twee fasen: een leerfase en een evaluatiefase. Leerfase modellen de naderingsbasis doneert trainingsgegevens, terwijl de evaluatiefase de output voorspelt voor de gegeven gegevens. We konden hun toepassingen vinden in e-mailspam, voorspelling van bankleningen, spraakherkenning, sentimentanalyse. De techniek omvat wiskundige functie f met ingang X en uitgang Y.

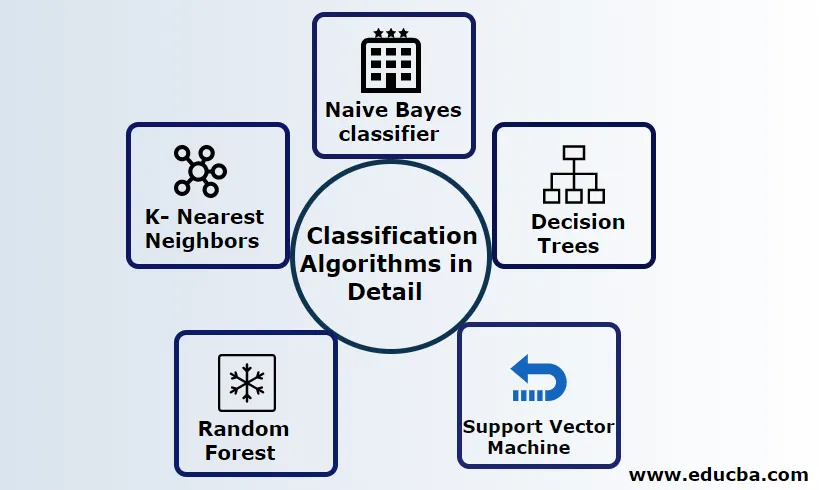

Classificatie-algoritmen gedetailleerd beschrijven

Classificatie kan worden uitgevoerd op zowel gestructureerde als ongestructureerde gegevens. Classificatie kan worden onderverdeeld in

- Naïeve Bayes-classificator

- Beslissingsbomen

- Ondersteuning Vector Machine

- Willekeurig bos

- K - Dichtstbijzijnde buren

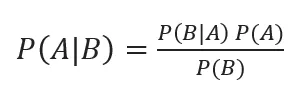

1) Naïeve Bayes-classificator

Het is een op theorema gebaseerd algoritme van Bayes, een van de statistische classificaties en vereist weinig hoeveelheden trainingsgegevens om de parameters te schatten die ook wel probabilistische classificatoren worden genoemd. Het wordt beschouwd als de snelste classificeerder, zeer schaalbaar en verwerkt zowel discrete als continue gegevens. Dit algoritme maakte in realtime een voorspelling. Er zijn verschillende soorten naïeve classificaties, Multinomiale Naïeve Bayes, Bernoulli Naïve Bayes, Gaussiaanse naïef.

Bayesiaanse classificatie met posterieure waarschijnlijkheden wordt gegeven door

Waar A, B gebeurtenissen zijn, P (A | B) - posterieure waarschijnlijkheden.

Als twee waarden onafhankelijk van elkaar zijn,

P (A, B) = P (A) P (B)

Naïeve Bayes kunnen worden gebouwd met behulp van de pythonbibliotheek. De voorspellers van Naïve zijn onafhankelijk, hoewel ze worden gebruikt in aanbevelingssystemen. Ze worden gebruikt in veel realtime-toepassingen en worden willens en wetens gebruikt in documentclassificatie.

voordelen:

Voordelen zijn dat ze veel minder rekenkracht vereisen, verondersteld in meervoudige klassenvoorspellingsproblemen, nauwkeurig werken op grote datasets.

Nadeel:

Het grootste nadeel van deze classificator is dat ze nul waarschijnlijkheid zullen toekennen. En ze hebben functies met onafhankelijk van elkaar.

2) Beslisboom

Het is een top-down benaderingsmodel met de structuur van het stroomdiagram verwerkt hoog-dimensionale gegevens. De uitkomsten worden voorspeld op basis van de gegeven invoervariabele. Beslisboom samengesteld uit de volgende elementen: Een wortel, veel knopen, takken, bladeren. De root-node doet de partitie op basis van de attribuutwaarde van de klasse, de interne node neemt een attribuut voor verdere classificatie, takken nemen een beslissingsregel om de knooppunten in bladknooppunten te splitsen, ten slotte geven de bladknooppunten ons het uiteindelijke resultaat. De tijdcomplexiteit van de beslissingsboom is afhankelijk van het aantal records, kenmerken van de trainingsgegevens. Als de beslissingsboom te lang is, is het moeilijk om de gewenste resultaten te krijgen.

Voordeel: ze worden toegepast voor voorspellende analyses om de problemen op te lossen en worden in dagelijkse activiteiten gebruikt om het doel te kiezen op basis van beslissingsanalyse. Bouwt automatisch een model op basis van de brongegevens. Het beste in het omgaan met ontbrekende waarden.

Nadeel: de grootte van de boom is oncontroleerbaar totdat deze enkele stopcriteria heeft. Vanwege hun hiërarchische structuur is de boom onstabiel.

3) Ondersteuning van vectormachine

Dit algoritme speelt een cruciale rol in classificatieproblemen en het meest populair is een machine learning onder toezicht gehouden algoritmen. Het is een belangrijk hulpmiddel dat wordt gebruikt door de onderzoeker en datawetenschapper. Deze SVM is heel eenvoudig en het proces is om een hyperplane te vinden in een N-dimensionale ruimte datapunten. Hyperplanes zijn beslissingsgrenzen die de gegevenspunten classificeren. Al deze vector komt dichter bij het hypervlak, maximaliseer de marge van de classificator. Als de marge maximaal is, is de laagste de generalisatiefout. Hun implementatie kan worden gedaan met de kernel met behulp van python met enkele trainingsdatasets. Het hoofddoel van de SVM is een object te trainen in een bepaalde classificatie. SVM is niet beperkt om een lineaire classificeerder te worden. SVM heeft meer de voorkeur dan enig classificatiemodel vanwege hun kernelfunctie die de rekenefficiëntie verbetert.

Voordeel: ze hebben een hoge voorkeur vanwege de minder rekenkracht en effectieve nauwkeurigheid. Effectief in hoge dimensionale ruimte, goede geheugenefficiëntie.

Nadeel: beperkingen in snelheid, kernel en grootte

4) Willekeurig bos

Het is een krachtig algoritme voor machine-learning gebaseerd op de leerbenadering van Ensemble. De basisbouwsteen van Random forest is de beslissingsboom die wordt gebruikt om voorspellende modellen te bouwen. De werkdemonstratie omvat het creëren van een bos van willekeurige beslissingsbomen en het snoeiproces wordt uitgevoerd door een stop-splitsing in te stellen om een beter resultaat te krijgen. Random forest wordt geïmplementeerd met behulp van een techniek genaamd bagging voor besluitvorming. Dit opzakken voorkomt overfitting van gegevens door de bias op dezelfde manier te verminderen, waardoor deze random betere nauwkeurigheid kan bereiken. Een laatste voorspelling wordt gedaan door een gemiddelde van veel beslissingsbomen, dat wil zeggen frequente voorspellingen. Het willekeurige forest bevat veel gebruiksscenario's, zoals beursvoorspellingen, frauduleuze detectie, nieuwsvoorspellingen.

voordelen:

- Vereist geen grote verwerking om de datasets te verwerken en een zeer eenvoudig model om te bouwen. Biedt grotere nauwkeurigheid helpt bij het oplossen van voorspellende problemen.

- Werkt goed in het omgaan met ontbrekende waarden en detecteert automatisch een uitbijter.

Nadeel:

- Vereist hoge rekenkosten en veel geheugen.

- Vereist veel meer tijdsperiode.

5) K- Dichtstbijzijnde buren

Hier zullen we het K-NN-algoritme bespreken met begeleid leren voor CART. Ze maken gebruik van K positief klein geheel getal; een object wordt toegewezen aan de klasse op basis van de buren of we zullen zeggen een groep toewijzen door te observeren in welke groep de buurman ligt. Dit wordt gekozen door afstandsmaat Euclidische afstand en een brute kracht. De waarde van K kan worden gevonden met behulp van het afstemmingsproces. KNN wil liever geen model leren om een nieuwe gegevensset te trainen en normalisatie te gebruiken om gegevens opnieuw te schalen.

Voordeel: produceert effectieve resultaten als de trainingsgegevens enorm zijn.

Nadeel: het grootste probleem is dat als de variabele klein is, deze goed werkt. Ten tweede, de K-factor kiezen tijdens het classificeren.

Conclusie

Concluderend, we hebben de mogelijkheden van verschillende classificatie-algoritmen doorlopen en fungeert nog steeds als een krachtig hulpmiddel in functie-engineering, beeldclassificatie die een geweldige bron is voor machine learning. Classificatie-algoritmen zijn krachtige algoritmen die harde problemen oplossen.

Aanbevolen artikelen

Dit is een gids voor classificatie-algoritmen bij machine learning. Hier bespreken we dat de classificatie kan worden uitgevoerd op zowel gestructureerde als ongestructureerde gegevens. U kunt ook onze andere voorgestelde artikelen doornemen -

- Routeringsalgoritmen

- Clustering Algoritme

- Datamining-proces

- Machine Learning-algoritmen

- Meest gebruikte technieken van ensemble leren

- C ++ Algoritme | Voorbeelden van C ++ algoritme